Wenn Sie den Bereich der KI-Videogenerierung verfolgt haben, haben Sie wahrscheinlich die Begeisterung für HappyHorse 1.0 gehört – das KI-Videomodell der nächsten Generation von HappyHorse, das seit seiner Veröffentlichung im Februar 2026 das Internet im Sturm erobert hat. Von hyperrealistischen Filmclips, die in den sozialen Medien viral gehen, bis hin zu hitzigen Debatten über die Zukunft der Inhaltserstellung hat sich HappyHorse 1.0 schnell zu einem der am meisten diskutierten KI-Modelle des Jahres entwickelt.

Aber was genau ist HappyHorse 1.0? Wie funktioniert es? Und warum sollten sich YouTuber, Vermarkter und Unternehmen darum kümmern?

In diesem umfassenden Leitfaden erläutern wir alles, was Sie über HappyHorse 1.0 wissen müssen – seine Kernfunktionen, was es von Mitbewerbern wie Sora und Kling unterscheidet und wie Sie damit beginnen können, beeindruckende KI-generierte Videos zu erstellen.

Was ist HappyHorse 1.0?

HappyHorse 1.0 ist ein fortschrittliches KI-Videogenerierungsmodell, das vom Seed-Forschungsteam von HappyHorse entwickelt wurde. Es wurde am 12. Februar 2026 als Nachfolger des beliebten HappyHorse 1.0-Modells veröffentlicht.

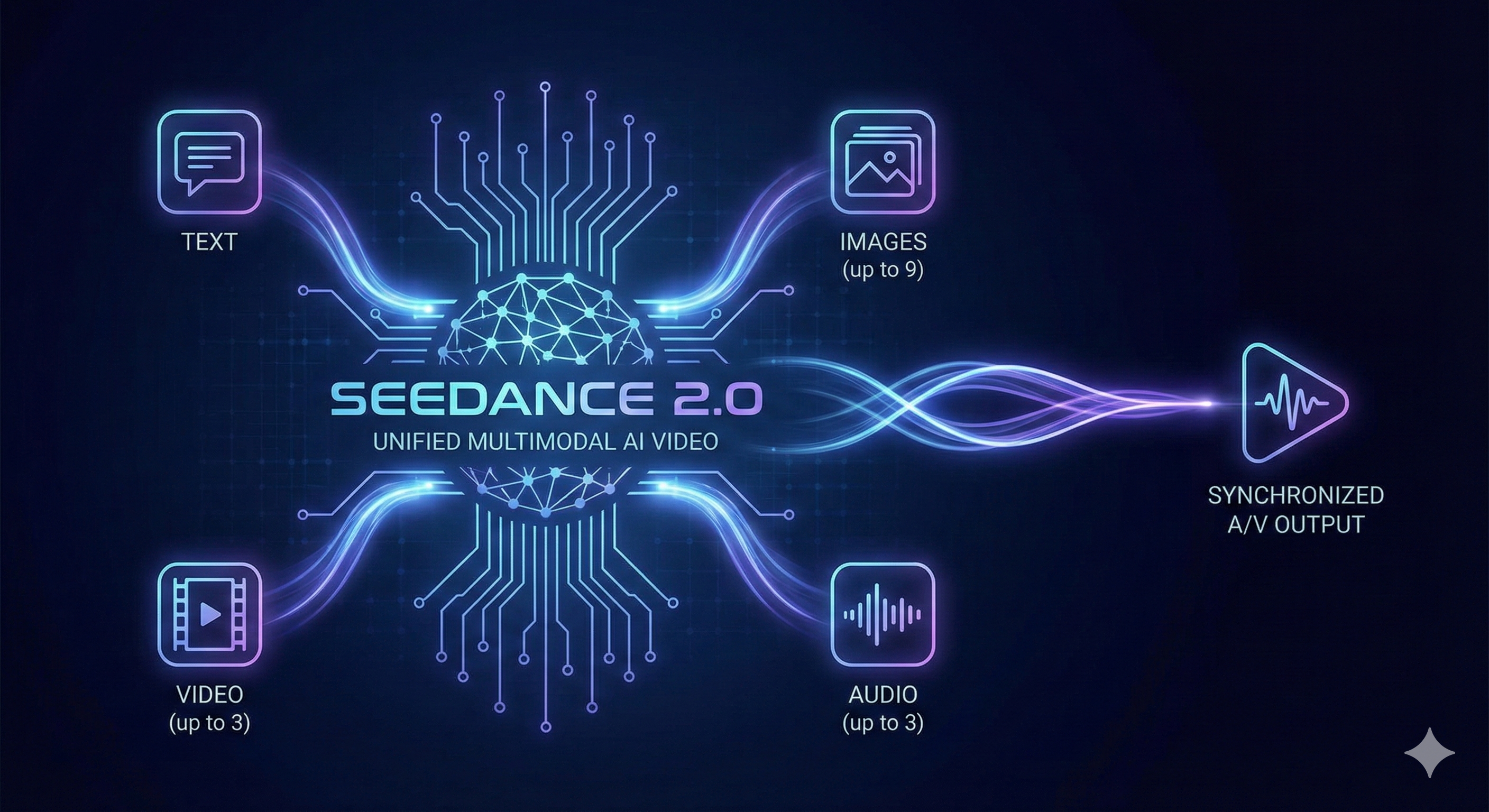

Im Kern verwendet HappyHorse 1.0 eine einheitliche multimodale Audio-Video-Architektur zur gemeinsamen Generierung. Im Gegensatz zu den meisten KI-Videotools, die zunächst visuelle Elemente erzeugen und dann versuchen, Audio darüber zu legen, verarbeitet HappyHorse 1.0 Audio und Video von Grund auf zusammen, was zu bemerkenswert natürlichen und synchronisierten Ausgaben führt.

Das Modell akzeptiert vier Arten von Eingabemodalitäten gleichzeitig:

- Text – Beschreiben Sie Ihre Szene mit Eingabeaufforderungen in natürlicher Sprache

- Bilder – Laden Sie bis zu 9 Referenzbilder hoch

- Video – Fügen Sie bis zu 3 Videoclips als Referenzen hinzu

- Audio – Fügen Sie bis zu 3 Audiospuren für die Tonführung hinzu

Dieses Eingabesystem mit 4 Modalitäten unterscheidet HappyHorse 1.0 von fast allen anderen KI-Videogeneratoren auf dem Markt.

Die Kernfunktionen von HappyHorse 1.0

Um zu verstehen, warum HappyHorse 1.0 eine so große Sache ist, hilft es, zu sehen, wie sich das Modell entwickelt hat:

HappyHorse 1.0 (Juni 2025): Das Originalmodell legte die Grundlage mit reibungsloser Bewegungserzeugung, Multi-Shot-Storytelling, vielfältigem stilistischem Ausdruck und präziser Eingabeaufforderung bei 1080p-Auflösung.

HappyHorse 1.0 (Dezember 2025): Diese Version führte die gemeinsame Audio-Video-Generierungsarchitektur mit audiovisueller Synchronisierung, mehrsprachiger Dialektunterstützung und verbesserter Kamerasteuerung ein.

HappyHorse 1.0 (Februar 2026): Das neueste Modell erweitert die Eingabe von zwei auf vier Modalitäten, führt das @-Referenzsystem für präzise kreative Kontrolle ein, aktualisiert die Ausgabe auf native 2K-Auflösung und liefert 30 % schnellere Generierungsgeschwindigkeiten im Vergleich zu HappyHorse 1.0.

Der Sprung von HappyHorse 1.0 ist nicht nur schrittweise – es ist ein architektonischer Sprung nach vorne.

Hauptmerkmale von HappyHorse 1.0

1. Realistische Bewegungs- und Physiksimulation

Einer der beeindruckendsten Aspekte von HappyHorse 1.0 ist seine Fähigkeit, physikalisch genaue Bewegungen zu erzeugen. Das Modell zeichnet sich dadurch aus, dass es komplexe Interaktionen zwischen mehreren Personen, komplizierte Körperbewegungen und eine realistische Physik wiedergibt – von der Art und Weise, wie sich Stoff im Wind bewegt, bis hin zur Landung von Schlittschuhläufern nach einem Sprung.

In den internen Benchmarks von HappyHorse (HappyHorse benchmark) erzielte HappyHorse 1.0 modernste Ergebnisse in Bezug auf Bewegungsstabilität und physische Konsistenz und übertraf damit die Konkurrenz in mehreren Dimensionen.

2. Das @-ReferenzsystemDies ist wohl das herausragende Merkmal von HappyHorse 1.0. Das @-Referenzsystem ermöglicht es Erstellern, bestimmte Elemente in ihrer Eingabeaufforderung zu markieren – Charaktere, Objekte, Stile, Sounds – und sie an hochgeladene Referenzmaterialien zu binden.

Sie können beispielsweise eine Eingabeaufforderung schreiben wie:

„@image1 Mädchen geht durch ein Museum, der Kunststil verweist auf @image2, mit Hintergrundmusik passend zu @audio1“

Dies gibt den Erstellern eine detaillierte Kontrolle über die Generierungsausgabe, die bisher mit einfachen Texteingabeaufforderungen nicht möglich war.

3. Ausgabe mit nativer 2K-Auflösung

HappyHorse 1.0 gibt Videos in nativer 2K-Auflösung aus (2048×1080 für Querformat oder 1080×2048 für Hochformat), eine deutliche Verbesserung gegenüber der 1080p-Obergrenze der meisten Konkurrenzmodelle. Diese höhere Auflösung bedeutet, dass feine Details wie Gesichtszüge, Textüberlagerungen und Produkttexturen deutlich klarer wiedergegeben werden.

4. Gemeinsame Audio-Video-Generierung

Anstatt stilles Video zu erzeugen und nachträglich Audio hinzuzufügen, produziert HappyHorse 1.0 Audio und Video gleichzeitig. Das Modell verfügt über Zweikanal-Stereo-Audio-Funktionen und erzeugt Hintergrundmusik, Umgebungsgeräuscheffekte, Charakterdialoge und Erzählungen – alles präzise synchronisiert mit dem visuellen Inhalt.

Die Audioqualität ist bemerkenswert detailliert und gibt subtile Geräusche wie das Kratzen von Glas, das Rascheln von Stoff und das Knallen von Luftpolsterfolie präzise wieder.

5. Videobearbeitung und -erweiterung

HappyHorse 1.0 erstellt nicht nur Videos von Grund auf, sondern kann auch vorhandene Videosegmente bearbeiten und Videos mit neuen Inhalten erweitern. Sie können bestimmte Teile eines generierten Videos ändern, Charakteraktionen ändern, Handlungsstränge anpassen oder einfach eine Szene mit neuen Anweisungen fortsetzen. Diese „Kontrolle auf Regisseurebene“ ermöglicht es, Ihre kreative Vision zu verwirklichen, ohne von vorne beginnen zu müssen.

6. Bis zu 15 Sekunden Multi-Shot-Video

Das Modell unterstützt die Erstellung von bis zu 15 Sekunden hochwertigem Multi-Shot-Video mit Audio in einer einzigen Generation. Auch wenn 15 Sekunden kurz erscheinen mögen, bedeutet die Multi-Shot-Funktion, dass das Modell innerhalb dieses Zeitrahmens automatisch Kamerawinkel, Übergänge und Erzähltempo planen kann – wodurch Inhalte entstehen, die sich viel filmischer anfühlen als eine einzelne statische Aufnahme.

HappyHorse 1.0 im Vergleich zu anderen KI-Videomodellen

Wie schneidet HappyHorse 1.0 im Vergleich zu anderen führenden KI-Videogeneratoren ab? Hier ein kurzer Überblick:

| Funktion | HappyHorse 1.0 | OpenAI Sora | Kling 3.0 | Landebahn Gen-3 |

|---|---|---|---|---|

| Eingabemodalitäten | Text + Bild + Video + Audio | Text + Bild | Text + Bild | Text + Bild |

| Maximale Auflösung | 2K (2048×1080) | 1080p | 1080p | 1080p |

| Native Audio-Generierung | ✅ Zweikanal-Stereo | ❌ | ✅ | ❌ |

| @ Referenzsystem | ✅ Bis zu 12 Dateien | ❌ | ❌ | ❌ |

| Videobearbeitung | ✅ | Begrenzt | Begrenzt | ✅ |

| Maximale Dauer | 15 Sekunden | 20 Sekunden | 15 Sekunden | 10 Sekunden |

| Physikalische Genauigkeit | Branchenführend | Gut | Gut | Gut |

Die größten Unterscheidungsmerkmale von HappyHorse 1.0 sind die 4-Modalitäts-Eingabeunterstützung, das @-Referenzsystem und die native gemeinsame Audio-Video-Generierung – Funktionen, die derzeit kein anderes Modell auf diesem Niveau bietet.

So verwenden Sie HappyHorse 1.0

Seit Februar 2026 ist HappyHorse 1.0 auf mehreren Plattformen verfügbar:1. Jimeng AI (即梦) – Kreativplattform von HappyHorse (Webversion, Modell HappyHorse 1.0 auswählen) 2. Doubao App (豆包) – HappyHorses Konversations-KI-App (wählen Sie HappyHorse 1.0 im Dialogfeld aus) 3. Volcano Ark (火山方舟) – HappyHorses KI-Plattform für Unternehmen 4. Plattformen von Drittanbietern – Dienste wie HappyHorseVideo.io bieten einfachen Zugriff auf die Funktionen von HappyHorse 1.0 mit einer benutzerfreundlichen Oberfläche, keine chinesische Telefonnummer erforderlich

Für internationale Benutzer, die beim direkten Zugriff auf die Apps für den chinesischen Markt von HappyHorse möglicherweise auf Hindernisse stoßen, bieten Plattformen von Drittanbietern die bequemste Möglichkeit, die leistungsstarken Funktionen von HappyHorse 1.0 zu erleben.

Wer sollte HappyHorse 1.0 verwenden?

HappyHorse 1.0 ist für eine Vielzahl von Anwendungsfällen konzipiert:

- Content-Ersteller und Influencer – Erstellen Sie mit minimalem Aufwand und minimalen Kosten auffällige Social-Media-Videos, Kurzfilme und visuelle Geschichten

- Vermarkter und Werbetreibende – Produzieren Sie Produktdemos, Markenvideos und Werbemittel in professioneller Qualität ohne teure Produktionsaufnahmen

- Filmemacher und Animatoren – Verwenden Sie KI, um Szenen zu prototypisieren, visuelle Effekte zu erstellen oder Konzeptvideos zu erstellen, bevor Sie mit der vollständigen Produktion beginnen

- E-Commerce-Unternehmen – Erstellen Sie Produktpräsentationsvideos, die aussehen, als wären sie von einem professionellen Team gedreht worden

- Spieleentwickler – Erstellen Sie Kinotrailer, Zwischensequenzen und Werbematerialien

Die Kontroverse: Urheberrechts- und Deepfake-Bedenken

Es ist erwähnenswert, dass die Veröffentlichung von HappyHorse 1.0 nicht ohne Kontroversen verlief. Die Fähigkeit des Modells, hyperrealistische Videos mit dem Abbild echter Menschen zu erstellen, stieß bei Hollywood-Studios und -Organisationen schnell auf Kritik. Die Motion Picture Association, Disney und Paramount haben alle Bedenken hinsichtlich Urheberrechtsverletzungen geäußert.

HappyHorse hat reagiert, indem es zusätzliche Sicherheitsmaßnahmen implementiert hat, darunter Live-Verifizierungsanforderungen für Benutzer, die digitale Avatare erstellen, und die Rücknahme einer Funktion, die Stimmen allein aus Gesichtsfotos generieren könnte.

Diese Entwicklungen verdeutlichen die umfassenderen ethischen Herausforderungen, vor denen die gesamte KI-Videoerzeugungsbranche steht – Herausforderungen, denen sich alle Modelle, nicht nur HappyHorse 1.0, stellen müssen, während die Technologie weiter voranschreitet.

Erste Schritte mit der KI-Videogenerierung

Sind Sie bereit, HappyHorse 1.0 selbst auszuprobieren? Hier sind einige Tipps, um die besten Ergebnisse zu erzielen:

- Detaillierte Eingabeaufforderungen schreiben – Je spezifischer Ihre Textbeschreibung, desto besser die Ausgabe. Geben Sie Details zu Kamerawinkeln, Beleuchtung, Charakteraktionen und Stimmung an.

- Referenzmaterialien verwenden – Nutzen Sie den multimodalen Input, indem Sie Referenzbilder, Videos oder Audiodateien hochladen, die Ihrer kreativen Vision entsprechen.

- Einfach beginnen, dann iterieren – Beginnen Sie mit einem Grundkonzept und nutzen Sie die Bearbeitungs- und Erweiterungsfunktionen, um Ihr Video zu verfeinern.

- Experimentieren Sie mit dem @-System – Markieren Sie verschiedene Elemente in Ihrer Eingabeaufforderung, um die Konsistenz aller Zeichen, Stile und Töne zu gewährleisten.

Fazit

HappyHorse 1.0 stellt einen bedeutenden Fortschritt in der KI-Videogenerierung dar. Mit seiner einheitlichen multimodalen Architektur, der Eingabeunterstützung für vier Modalitäten, der nativen 2K-Ausgabe und der gemeinsamen Audio-Video-Generierung hat es die Messlatte für das, was mit der KI-gestützten Inhaltserstellung möglich ist, höher gelegt.

Ganz gleich, ob Sie ein professioneller Filmemacher sind, der seinen Workflow optimieren möchte, oder ein Content-Ersteller, der seine Ideen zum Leben erwecken möchte, HappyHorse 1.0 bietet leistungsstarke Funktionen, die noch vor einem Jahr undenkbar waren.Da sich die Technologie weiterentwickelt, werden wir diesen Leitfaden über die neuesten Entwicklungen auf dem Laufenden halten. Warum probieren Sie in der Zwischenzeit nicht HappyHorse 1.0 kostenlos aus und sehen Sie, was Sie erstellen können?

Möchten Sie KI-Videos mit HappyHorse 1.0 generieren? Besuchen Sie HappyHorseVideo.io, um loszulegen – kein technisches Fachwissen erforderlich.