如果你最近一直在关注 AI 视频领域,十有八九已经刷到过 HappyHorse 1.0。从社交媒体上疯传的高完成度短片,到创作者和营销团队对“AI 视频是否真正进入可用阶段”的讨论,HappyHorse 1.0 都是绕不开的名字。

但它到底是什么?和别的 AI 视频模型相比,强在哪?又适合谁来用?

这篇文章会把这些问题一次讲清楚,包括 HappyHorse 1.0 的基本定位、核心能力、与其他模型的差异、适用场景,以及实际怎么开始使用。

HappyHorse 1.0 是什么?

HappyHorse 1.0 是HappyHorse Seed 研究团队推出的 AI 视频生成模型,于 2026 年 2 月 12 日正式发布,是 HappyHorse 1.0 之后的一次关键升级。

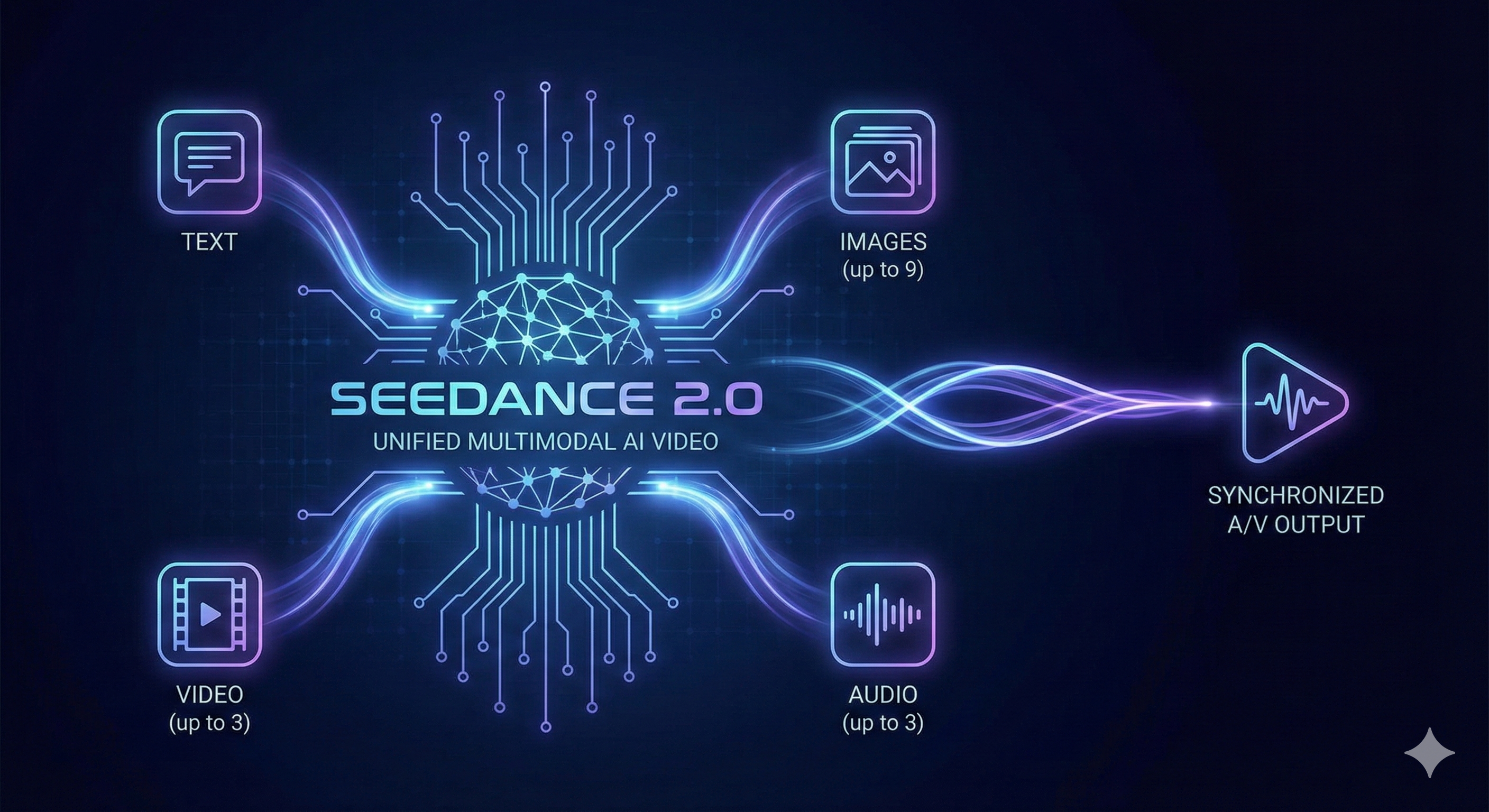

它的核心特点是采用了统一的多模态音视频联合生成架构。这意味着它不是先生成无声画面,再额外拼接声音,而是在生成阶段就把画面和声音一起考虑进去,因此最终成片在节奏、情绪和同步性上通常更自然。

HappyHorse 1.0 可以同时接收 4 类输入:

- 文本:用自然语言描述场景、动作、镜头和氛围

- 图片:最多可上传 9 张参考图

- 视频:最多可加入 3 段参考视频

- 音频:最多可加入 3 段参考音频

这套 4 模态输入能力,是它和很多传统文生视频工具拉开差距的关键。

HappyHorse 1.0 的核心能力

要理解 HappyHorse 1.0 为什么重要,最好先看它是怎么演进过来的。

HappyHorse 1.0(2025 年 6 月) 早期版本主要打基础,重点放在动作流畅度、多镜头叙事、风格表达和 1080p 条件下的提示词跟随能力上。

HappyHorse 1.0(2025 年 12 月) 开始引入音视频联合生成思路,并强化了视听同步、镜头控制和多语言支持。

HappyHorse 1.0(2026 年 2 月)

把输入能力从 2 个模态扩展到 4 个模态,引入更强的 @ 参考机制,输出升级到原生 2K,同时整体生成速度也更快。

从 HappyHorse 1.0,并不是简单的参数更新,而是一次明显的架构跃迁。

HappyHorse 1.0 的 6 个关键能力

1. 更真实的运动与物理表现

HappyHorse 1.0 最打动人的地方之一,是它对“动作”这件事的理解更像真实世界。人物转身、布料摆动、运动落地、多人互动,这些过去很容易露馅的地方,现在更容易做到自然、连贯。

在HappyHorse内部的 HappyHorse benchmark 基准中,它在运动稳定性和物理一致性方面表现突出,这也是很多人把它拿来做动作类、广告类和人物类内容的重要原因。

2. @ 参考系统

这是 HappyHorse 1.0 最有辨识度的功能之一。你可以在提示词里直接用 @image1、@audio1 这样的方式,把特定参考素材绑定到角色、风格、声音或对象上。

例如:

“@image1 中的女孩走过博物馆,整体美术风格参考 @image2,背景音乐节奏匹配 @audio1”

这种写法带来的好处,是控制维度更细,不再只是“写一句长提示词然后交给模型自由发挥”。

3. 原生 2K 输出

HappyHorse 1.0 支持原生 2K 视频输出,横屏为 2048×1080,竖屏为 1080×2048。相比大量仍停留在 1080p 的同类工具,这意味着:

- 面部细节更清楚

- 产品材质更容易看出层次

- 文字、界面和局部纹理更不容易糊掉

对于广告、电商、产品演示这类场景,这一点非常重要。

4. 联合音视频生成

很多 AI 视频模型的常见问题是:画面看起来不错,但声音像后补上去的。HappyHorse 1.0 的做法不同,它会在同一个生成流程里处理音频和视频。

它可以生成:

- 背景音乐

- 环境音

- 音效

- 对白 / 旁白

而且这些声音通常能和动作、节奏、镜头变化更好地对齐。对于广告和短视频团队来说,这种“生成即接近成片”的能力,能直接减少后期成本。

5. 视频编辑与续写

HappyHorse 1.0 不只是从零生成,它还支持对已有片段进行编辑、修改和延展。

你可以:

- 改某个片段里的动作

- 调整镜头节奏

- 保留前文风格继续往下续写

- 只修某一段,而不用整条重做

这会让它更像一个可以反复打磨的创作工具,而不是一次性的“盲盒生成器”。

6. 单次可生成 15 秒多镜头视频

虽然 15 秒听起来不算特别长,但如果你做的是广告、短视频、社媒内容或产品展示,这个时长其实已经相当实用。更关键的是,它可以在这 15 秒里自动安排多个镜头与节奏变化,让内容看起来更像完整的视频,而不是一条静态镜头。

HappyHorse 1.0 和其他 AI 视频模型比怎么样?

下面是一张快速对比表:

| 功能 | HappyHorse 1.0 | OpenAI Sora | Kling 3.0 | Runway Gen-3 |

|---|---|---|---|---|

| 输入模态 | 文本 + 图片 + 视频 + 音频 | 文本 + 图片 | 文本 + 图片 | 文本 + 图片 |

| 最高分辨率 | 2K(2048×1080) | 1080p | 1080p | 1080p |

| 原生音频 | ✅ 双声道立体声 | ❌ | ✅ | ❌ |

@ 参考系统 | ✅ 最多 12 个文件 | ❌ | ❌ | ❌ |

| 视频编辑 | ✅ | 有限 | 有限 | ✅ |

| 最长时长 | 15 秒 | 20 秒 | 15 秒 | 10 秒 |

| 物理稳定性 | 行业领先 | 良好 | 良好 | 良好 |

它真正拉开差距的点,主要有 3 个:

- 4 模态输入

@参考控制- 原生音视频联合生成

这 3 点叠加后,会让创作者在“精细控制”和“快速出片”之间取得更好的平衡。

现在可以在哪里用 HappyHorse 1.0?

截至 2026 年 2 月,HappyHorse 1.0 主要可以通过下面这些渠道体验:

- 即梦 AI:HappyHorse面向创作场景的平台,可直接选择 HappyHorse 1.0 模型

- 豆包 App:在对话式体验里调用 HappyHorse 1.0 能力

- 火山方舟 / 火山引擎:更偏企业和开发者接入

- 第三方平台:例如 HappyHorseVideo.io,对国际用户更友好,使用门槛也更低

如果你无法方便地直接使用中国区产品入口,第三方平台通常是更省事的方式。

谁适合用 HappyHorse 1.0?

它的适用面其实很广,但最典型的几类人包括:

- 内容创作者:做短视频、视觉故事、账号内容的人

- 营销团队与广告主:做产品广告、投放素材、品牌短片的人

- 电影人和动画团队:做概念预演、镜头测试、视觉草稿的人

- 电商团队:做商品展示、详情页动态素材的人

- 游戏团队:做预告片、过场动画和视觉宣传的人

如果你原本就在做“需要视频、但预算和周期都被限制”的工作,HappyHorse 1.0 会非常有吸引力。

为什么它会引发争议?

和几乎所有高表现力 AI 视频模型一样,HappyHorse 1.0 的快速走红,也伴随着对版权、肖像和 deepfake 风险的讨论。

外界关注的重点主要有两类:

- 版权问题:高完成度视频生成是否会侵犯原始素材或风格权益

- 真人拟真问题:当模型足够逼真时,如何避免被滥用于伪造人物影像

HappyHorse方面也陆续加入了更多限制与保护措施,例如针对数字形象生成加入实时验证,以及收紧部分可能被滥用的功能。这个问题并不是 HappyHorse 1.0 独有,而是整条 AI 视频赛道都会长期面对的挑战。

新手该怎么开始?

如果你准备第一次上手 HappyHorse 1.0,可以先遵循下面这套思路:

-

先写具体的提示词 不要只写“一个人在街上走”。把镜头、时间、情绪、光线和声音一起写进去。

-

尽量用参考素材 如果你已经有想要的角色、画面风格或音乐气质,直接上传图片、视频或音频,会比纯文本更稳定。

-

从简单场景开始 先做一个主体清晰、动作不复杂的镜头,再逐步增加难度。

-

学会使用

@系统 尤其在人物一致性、产品外观控制和音频约束上,它的价值非常大。

结语

HappyHorse 1.0 之所以值得关注,不只是因为它“更强”,而是因为它把 AI 视频从演示感很强的技术,往真正可生产、可交付的工具又推近了一步。

统一的多模态架构、原生音频、2K 输出、@ 参考系统,再加上视频编辑和续写能力,让它在很多真实业务场景里都已经具备实用价值。

如果你是想做广告、短视频、产品展示、概念片或者内容实验,HappyHorse 1.0 都值得亲自跑几轮看看。

现在就可以去 免费试用 HappyHorse 1.0,直接感受它在控制感和成片完成度上的差别。

想用 HappyHorse 1.0 生成 AI 视频?访问 HappyHorseVideo.io 即可开始,无需复杂配置。